近日,阿里云人工智能平臺PAI正式發(fā)布自研的DeepRec Extension(即 DeepRec 擴展),旨在以更低成本,更高效率進行稀疏模型的分布式訓(xùn)練。DeepRec Extension 在 DeepRec 訓(xùn)練推理框架之上,圍繞大規(guī)模稀疏模型分布式訓(xùn)練,創(chuàng)新性地從訓(xùn)練任務(wù)的視角提出了自動彈性訓(xùn)練和分布式容錯功能,進一步提升稀疏模型訓(xùn)練的整體效率,助力 DeepRec 引擎在稀疏場景中發(fā)揮更大的優(yōu)勢。

DeepRec Extension 有效地解決了企業(yè)級場景大規(guī)模稀疏模型訓(xùn)練中的難點。隨著業(yè)務(wù)發(fā)展,模型尺寸增長到百 GB / TB 量級,分布式訓(xùn)練往往會遇到分布式建模接口復(fù)雜、資源預(yù)估困難且無法彈性、分布式容錯機制過于簡單和分布式環(huán)境復(fù)雜等問題,阻礙大尺寸模型高效、穩(wěn)定地完成訓(xùn)練。DeepRec Extension 提供易用、高效、高性價比的框架,使得模型能夠便捷地在分布式環(huán)境中運行,切實解決上述問題。

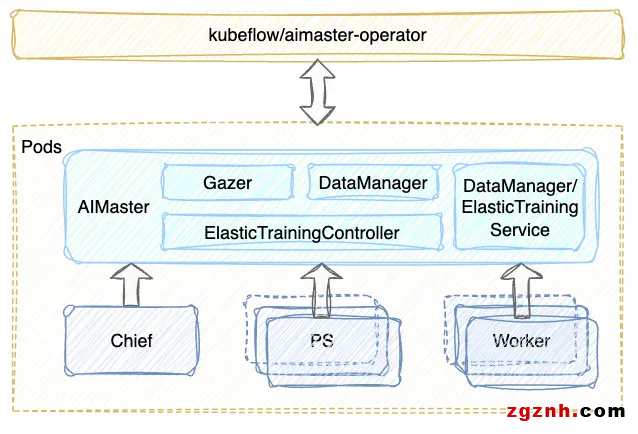

DeepRec Extension 設(shè)計思路及整體架構(gòu)

DeepRec Extension 推出分布式訓(xùn)練資源預(yù)估、自動彈性訓(xùn)練、資源/計算圖監(jiān)控、自動備份容錯等功能,有效降低了大規(guī)模稀疏模型訓(xùn)練的技術(shù)門檻和成本,同時提升了分布式訓(xùn)練的效率和穩(wěn)定性。DeepRec Extension 簡化分布式訓(xùn)練的工作流程,保障用戶聚焦于模型的構(gòu)建階段,更加專注于模型本身的創(chuàng)新與優(yōu)化,無需關(guān)注繁瑣的底層架構(gòu)配置。在性能提升方面,資源預(yù)估以及自動彈性訓(xùn)練為用戶節(jié)約 20% ~ 60% 資源,在穩(wěn)定性方面,PS 發(fā)生異常后,模型 E2E 訓(xùn)練吞吐提升 10%。

一直以來,大規(guī)模稀疏模型分布式訓(xùn)練是備受關(guān)注的

話題,阿里云人工智能平臺PAI正式將

DeepRec Extension 開源,與AI開發(fā)者共同打造更快更好的分布式訓(xùn)練框架,全面助力AI大模型發(fā)展!